Professional Documents

Culture Documents

Analisis de Regresion y Correlacion

Uploaded by

Tito Huillca0 ratings0% found this document useful (0 votes)

5 views2 pagesOriginal Title

ANALISIS DE REGRESION Y CORRELACION.docx

Copyright

© © All Rights Reserved

Available Formats

DOCX, PDF, TXT or read online from Scribd

Share this document

Did you find this document useful?

Is this content inappropriate?

Report this DocumentCopyright:

© All Rights Reserved

Available Formats

Download as DOCX, PDF, TXT or read online from Scribd

0 ratings0% found this document useful (0 votes)

5 views2 pagesAnalisis de Regresion y Correlacion

Uploaded by

Tito HuillcaCopyright:

© All Rights Reserved

Available Formats

Download as DOCX, PDF, TXT or read online from Scribd

You are on page 1of 2

ANALISIS DE REGRESION Y CORRELACION

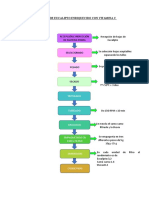

Analizar el grado de la relación existente entre variables utilizando modelos matemáticos y

representaciones gráficas. Así pues, para representar la relación entre dos o más

variables desarrollaremos una ecuación que permitirá estimar una variable en función de

la otra.

Por ejemplo, ¿en qué medida, un aumento de los gastos en publicidad hace aumentar las

ventas de un determinado producto?, ¿cómo representamos que la bajada de

temperaturas implica un aumento del consumo de la calefacción?,...

A continuación, estudiaremos dicho grado de relación entre dos variables en lo que

llamaremos análisis de correlación. Para representar esta relación utilizaremos una

representación gráfica llamada diagrama de dispersión y, finalmente, estudiaremos un

modelo matemático para estimar el valor de una variable basándonos en el valor de otra,

en lo que llamaremos análisis de regresión.

Definición de Correlación Lineal

En ocasiones nos puede interesar estudiar si existe o no algún tipo de relación entre dos variables

aleatorias. Así, por ejemplo, podemos preguntarnos si hay alguna relación entre las

notas de la asignatura Estadística I y las de Matemáticas I. Una primera aproximación al problema

consistiría en dibujar en el plano R2 un punto por cada alumno: la primera coordenada de cada

punto sería su nota en estadística, mientras que la segunda sería su nota en matemáticas. Así,

obtendríamos una nube de puntos la cual podría indicarnos visualmente la existencia o no de algún

tipo de relación (lineal, parabólica, exponencial, etc.) entre ambas notas.

Otro ejemplo, consistiría en analizar la facturación de una empresa en un periodo de tiempo dado y

de cómo influyen los gastos de promoción y publicidad en dicha facturación. Si consideramos un

periodo de tiempo de 10 años, una posible representación sería situar un punto por cada año de

forma que la primera coordenada de cada punto sería la cantidad en euros invertidos en

publicidad, mientras que la segunda sería la cantidad en euros obtenidos de su facturación. De

esta manera, obtendríamos una nube de puntos que nos indicaría el tipo de relación existente

entre ambas variables.

En particular, nos interesa cuantificar la intensidad de la relación lineal entre dos variables. El

parámetro que nos da tal cuantificación es el coeficiente de correlación lineal de Pearson r,

cuyo valor oscila entre –1 y +1

Significado del coeficiente de correlación

Recordamos en primer lugar algunas ideas básicas (que suponemos conocidas) sobre el

concepto e interpretación del coeficiente de correlación (r de Pearson):

r = expresa en qué grado los sujetos tienen el mismo orden en las variables X e Y. Si la

correlación es perfecta (r = 1) el orden de los sujetos en ambas variables es el mismo y

el diagrama de dispersión coincidirá con una recta (la recta de regresión)1.

r2 = expresa la proporción de variación conjunta (varianza común).

El coeficiente de relación supone y expresa relaciones lineares en las que a un mayor valor

en X corresponde un mayor valor de Y, como se ve gráficamente en los diagramas de

dispersión.

Sin embargo el valor de la correlación por sí solo no nos dice si la relación es linear: la relación

puede ser curvilínea: a más X corresponde más Y, hasta llegar a un punto de inflexión en el que

si aumenta X empieza a bajar Y.

Correlación y predicción

En el caso de relación perfecta entre dos variables (r = 1) el diagrama de dispersión sería

una recta, y trazando una perpendicular desde el eje de las abscisas (X, variable independiente

o

predictora) hasta la recta y trazando desde la recta otra perpendicular hasta el eje de las

coordenadas (Y, variable dependiente o predicha o explicada por X) tendríamos la puntuación

en

Y que corresponde a una determinada puntuación en X.

La variable criterio o dependiente (Y) es la que buscamos explicar o estimar (o predecir)

por su relación con la variable X, que es la variable independiente, explicativa o predictora.

Unas

veces nuestra intención será predecir o hacer una estimación de la puntuación en Y de un sujeto

una vez conocida su puntuación en X; otras veces más que predecir en sentido propio nos

interesa

ver simplemente en qué medida las diferencias en X explican las diferencias en Y4.

Estamos suponiendo que ambas variables, X e Y, son continuas pero la variable

independiente (X) también puede ser dicotómica (1 ó 0), como puede ser la pertenencia a un

grupo u otro (por ejemplo, grupos experimental y control); en cualquier caso ahora nos

referimos

a puntuaciones continuas.

Si la correlación, como suele suceder, no es perfecta, el diagrama de dispersión ya no

coincidirá con una recta, aunque sí podemos trazar la recta que mejor expresa la relación (recta

de regresión).

La recta que mejor se ajusta a los datos es la que minimiza las diferencias (elevadas al

cuadrado) de los puntos con respecto a la recta (recta de cuadrados mínimos). El símbolo r del

coeficiente de correlación (desarrollado después por Pearson) viene del concepto de regresión.

You might also like

- Geomtria 5to Año-TRILCEDocument258 pagesGeomtria 5to Año-TRILCELuis Antonio Julca AhumadaNo ratings yet

- Resumen TGSDocument14 pagesResumen TGSLuis Valderrama VenegasNo ratings yet

- Numeracion y ViñetasDocument1 pageNumeracion y ViñetasTito HuillcaNo ratings yet

- Matrices para Eleccion de La Idea de NegocioDocument4 pagesMatrices para Eleccion de La Idea de NegocioTito HuillcaNo ratings yet

- Universidad Nacional Del Centro Del Perú Facultad de Ingeniería en Industrias Alimentarias Dirección de Departamento AcadémicoDocument4 pagesUniversidad Nacional Del Centro Del Perú Facultad de Ingeniería en Industrias Alimentarias Dirección de Departamento AcadémicoTito HuillcaNo ratings yet

- The Simpson Family - EspañolDocument2 pagesThe Simpson Family - EspañolTito HuillcaNo ratings yet

- Plan de TesisDocument17 pagesPlan de TesisTito HuillcaNo ratings yet

- Cuaderno de AnotacionesDocument1 pageCuaderno de AnotacionesTito HuillcaNo ratings yet

- Variable IndependienteDocument1 pageVariable IndependienteTito HuillcaNo ratings yet

- Planteamiento y Formulación Del Problema de InvestigaciónDocument1 pagePlanteamiento y Formulación Del Problema de InvestigaciónTito HuillcaNo ratings yet

- TRABAJODocument1 pageTRABAJOTito HuillcaNo ratings yet

- Taller de Aplicación de MendeleyDocument2 pagesTaller de Aplicación de MendeleyTito HuillcaNo ratings yet

- Practica Calificada Analisis Sensorial Tukey SPSSDocument9 pagesPractica Calificada Analisis Sensorial Tukey SPSSTito HuillcaNo ratings yet

- Estudio de MercadoDocument26 pagesEstudio de MercadoTito HuillcaNo ratings yet

- Breve Resumen Del NegocioDocument2 pagesBreve Resumen Del NegocioTito HuillcaNo ratings yet

- Filtrante de Eucalipto Enriquecido Con Vitamina CDocument6 pagesFiltrante de Eucalipto Enriquecido Con Vitamina CTito HuillcaNo ratings yet

- Solucion de Primer ExamenDocument3 pagesSolucion de Primer ExamenTito HuillcaNo ratings yet

- Segundo Examen e Ingenieria EconomicaDocument3 pagesSegundo Examen e Ingenieria EconomicaTito HuillcaNo ratings yet

- Paradigmas, Solis, Yauri, Tito, AvellanedaDocument8 pagesParadigmas, Solis, Yauri, Tito, AvellanedaTito HuillcaNo ratings yet

- E05ADocument4 pagesE05ATito HuillcaNo ratings yet

- Verb To Be - TitoDocument2 pagesVerb To Be - TitoTito HuillcaNo ratings yet

- Adivina Quien SoyDocument2 pagesAdivina Quien SoyTito HuillcaNo ratings yet

- Costo de Produccion Del Trabajo Ya Esta EnviadoDocument1 pageCosto de Produccion Del Trabajo Ya Esta EnviadoTito HuillcaNo ratings yet

- Propiedades Antioxidantes Del Café Verde Fermentado Frijoles Con Wickerhamomyces AnomalusDocument16 pagesPropiedades Antioxidantes Del Café Verde Fermentado Frijoles Con Wickerhamomyces AnomalusTito HuillcaNo ratings yet

- Huella Hidrica y Huella Del Carbono ActualDocument12 pagesHuella Hidrica y Huella Del Carbono ActualTito HuillcaNo ratings yet

- Watch The and Choose The Correct AnswerDocument1 pageWatch The and Choose The Correct AnswerTito HuillcaNo ratings yet

- Taller 3 - Rosales García, Jarol JoelDocument1 pageTaller 3 - Rosales García, Jarol JoelTito HuillcaNo ratings yet

- ACTIVIDAD 11 FINALTrabajo Integrador DMTIPIA - FINAL - FINALDocument47 pagesACTIVIDAD 11 FINALTrabajo Integrador DMTIPIA - FINAL - FINALTito HuillcaNo ratings yet

- Ley 31183 Del 02MAY2021 (Bachillerato Automático 2021-2021)Document2 pagesLey 31183 Del 02MAY2021 (Bachillerato Automático 2021-2021)Jorge Javier AruhuancaNo ratings yet

- Tablero de Control de La DespulpadoraDocument2 pagesTablero de Control de La DespulpadoraTito HuillcaNo ratings yet

- Plan de Negocio FormatoDocument6 pagesPlan de Negocio FormatoTito HuillcaNo ratings yet

- Practica 8 - Test Preferencia y DiferenciaDocument6 pagesPractica 8 - Test Preferencia y DiferenciaTito HuillcaNo ratings yet

- Lalg U2 A1 VatgDocument5 pagesLalg U2 A1 Vatgvanessa GonzalezNo ratings yet

- Tema 4 El Lenguaje Algebraico PDFDocument13 pagesTema 4 El Lenguaje Algebraico PDFOlga ArbuesNo ratings yet

- Expresiones Alg y Factorización PDFDocument11 pagesExpresiones Alg y Factorización PDFJOSE JULIAN MENA LORZANo ratings yet

- Proceso de Admisión Al TUVCH 2024Document12 pagesProceso de Admisión Al TUVCH 2024alejandro ramirezNo ratings yet

- Proyecto DiferencialesDocument9 pagesProyecto DiferencialesJuliana Hernandez GrisalesNo ratings yet

- C3 - Multiplicacion y Division de Numeros EnterosDocument4 pagesC3 - Multiplicacion y Division de Numeros EnterosAbner Sanchez CaruajulcaNo ratings yet

- Cepre UNI EcuacionesDocument2 pagesCepre UNI EcuacionesAlexGutierrezNo ratings yet

- 01.-Vectores y Fuerzas ConcurrentesDocument15 pages01.-Vectores y Fuerzas ConcurrentesEmerson MartinezNo ratings yet

- Ficha de Seguimiento Académico - Salazar Puma AbrahamDocument3 pagesFicha de Seguimiento Académico - Salazar Puma AbrahamABRAHAM FREDERISCK SALAZAR PUMA100% (1)

- Pruebas calidad generadores números pseudoaleatoriosDocument10 pagesPruebas calidad generadores números pseudoaleatoriosLupitha AnimusNo ratings yet

- Ejercicios en R Studio Comandos Básicos (Parte 1)Document8 pagesEjercicios en R Studio Comandos Básicos (Parte 1)dany guzmanNo ratings yet

- Practica Calificada Unidad N1Document3 pagesPractica Calificada Unidad N1NILSON CARLOS MACO CRUZNo ratings yet

- Declinacion de ReservoriosDocument8 pagesDeclinacion de ReservoriosArielNo ratings yet

- Teoria de La Informacion y La CodificacionDocument7 pagesTeoria de La Informacion y La CodificacionJuan David RNo ratings yet

- Proyecto #1Document7 pagesProyecto #1Jorge VasconcelosNo ratings yet

- PROGRAMACION LINEAL - Formulacion - Método GráficoDocument75 pagesPROGRAMACION LINEAL - Formulacion - Método GráficoPablo Mayorga RomeroNo ratings yet

- Tarea N°04Document4 pagesTarea N°04Victor BenitesNo ratings yet

- SucesionesAritméticasDocument3 pagesSucesionesAritméticasVilex Vila FloresNo ratings yet

- Diseno Bloques Completo Randomizado1Document25 pagesDiseno Bloques Completo Randomizado1Edward William Miranda GutierrezNo ratings yet

- Álgebra Sobre Un CuerpoDocument4 pagesÁlgebra Sobre Un Cuerpojosgau100% (1)

- Examen GlobalDocument3 pagesExamen GlobalJose Angel GutierrezNo ratings yet

- Semana 6Document15 pagesSemana 6josse obandoNo ratings yet

- Polinomios Interpolantes de LagrangeDocument5 pagesPolinomios Interpolantes de LagrangeSergioSegundoBarriosChicaisaNo ratings yet

- Verificación supuestos ANOVA DCADocument9 pagesVerificación supuestos ANOVA DCAKaorli AldazNo ratings yet

- Prueba Diagnóstica de Matemática - 3Document4 pagesPrueba Diagnóstica de Matemática - 3Euler Gomez PanduroNo ratings yet

- CF-302 Semana 2Document4 pagesCF-302 Semana 2Luis fiat luxNo ratings yet

- Diego MoralesDocument4 pagesDiego MoralesDiego FabianNo ratings yet

- Problemas Resueltos Cap 3 Fisica SerwayDocument7 pagesProblemas Resueltos Cap 3 Fisica SerwayGaston Chau25% (4)